-

[行业新闻] 登顶国际顶刊!浙江人形携手香港中文大学,攻......

2026-05-01

-

2026-04-30

-

[行业新闻] 破局飞翼车无人装卸:“全向AGV+”开启标......

2026-04-21

-

[行业新闻] MODEX2026 收官|AiTEN 亮相......

2026-04-18

-

[行业新闻] LogiMAT China 2026 会议......

2026-04-16

-

[行业新闻] 全球首发丨里工ChiroSync如意数采套......

2026-04-16

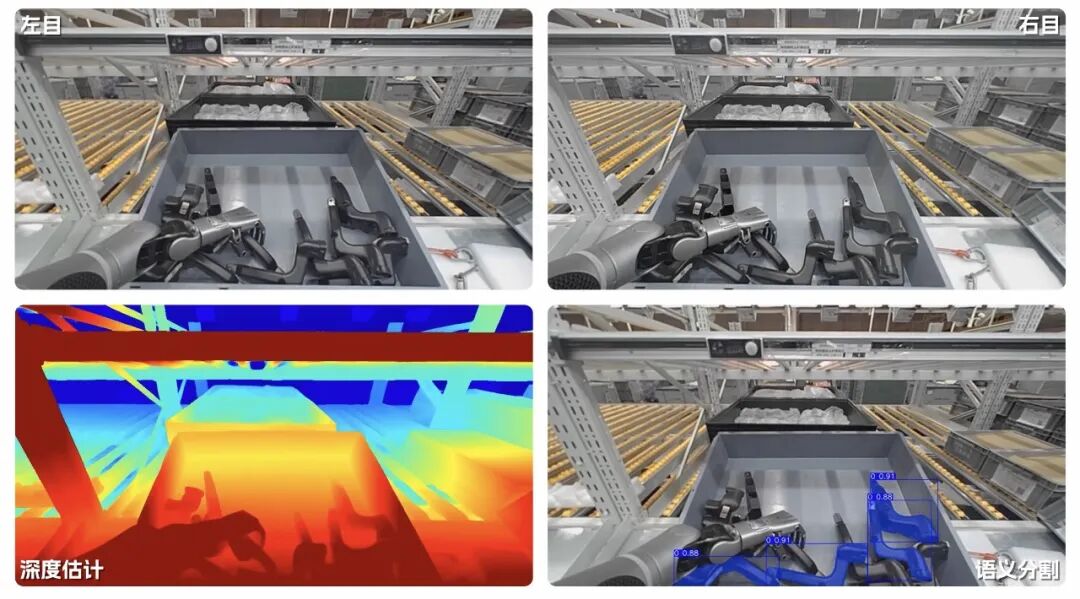

人形机器人的"眼睛"怎么看得更准?立体匹配技术作为机器感知深度的核心,直接决定着机器人导航的可靠性。但行业常用的soft-argmax方法始终存在痛点——容易输出"模糊答案"(多峰分布),导致深度计算偏差;此前的改进方案要么精度较差,要么运行速度较慢。

优必选研究院新提出的高斯采样(Sampling-Gaussian)方法,给出了"鱼与熊掌兼得"的解决方案,近期入选机器人顶会 IROS 2025 《The Sampling-Gaussian for Stereo Matching》。该论文创新性利用高斯概率采样实现监督训练,通过双目RGB图像实时生成高精度的稠密深度图,让新一代工业人形机器人Walker S2拥有媲美“人眼”的立体视觉感知能力。

论文标题:The Sampling-Gaussian for Stereo Matching

作者团队:Baiyu Pan, Bowen Yao, Jichao Jiao, Jianxing Pang, Jun Cheng

所属机构:优必选科技,中国科学院深圳先进技术研究院

论文地址:https://arxiv.org/pdf/2410.06527

录用会议:IROS 2025

研究背景与意义

主流的 soft-argmax 立体匹配方法,因易产生 “多峰概率分布”(即模型无法确定唯一深度值),导致深度出现误差;而过往改进方案要么通过增加网络层数提升精度,却让推理速度变慢(无法满足实时场景需求),要么简化模型结构,却让精度进一步下降 —— 这种 “精度与速度不可兼得” 的痛点,成为低成本深度感知技术落地的最大阻碍。

跳出传统思维的三重创新

高斯采样(Sampling-Gaussian)方法的核心是用高斯分布监督替代soft-argmax,却不增加任何推理负担,关键在于三个设计的创新:

向量视角的损失设计

首次将视差回归解读为向量点积问题,提出"L1损失+余弦相似度"组合函数——既算准数值距离,又对齐向量方向,避免模型陷入"多答案困境"。

破解分布偏移难题

扩展视差范围至(-dₑₓₜ, dₘₐₓ+dₑₓₜ),解决传统方法端点分布截断的问题;用双线性插值替代三线性插值,让概率分布更贴合真实规律。

零成本适配性

无需重构模型,直接替换原有soft-argmax模块,现有代码改几行就能用。

如下图展示,只基于L1损失进行训练时,Loss所表达的损失曲面与最终回归得到的深度误差(EPE)是存在误差的。而如果使用“L1损失+余弦相似度''的组合损失,两者在数值上非常接近。

实测数据

全场景碾压基线

在Sceneflow、KITTI等4大主流数据集上,高斯采样(Sampling-Gaussian)方法在5个基线模型上实现全量提升:

经典模型PSMNet端点误差(EPE)从0.87降至0.65,错误像素占比(D1)压至2.00%;

轻量化MSN2D在小数据集ETH3D上,EPE从0.86骤降至0.63;

推理时间与原模型完全一致,无需额外算力开销。

尤为突出的是,高斯采样(Sampling-Gaussian)对泛化能力弱的模型性能提升非常显著,比如将MSN3D在KITTI2015的D1误差从2.10%降至1.98%,为低成本设备的高精度感知提供了新思路。如下表4和5所示,基于Soft-argmax的方法在所有模型上均逊于本论文所提出的高斯采样(Sampling-Gaussian)方法,这表明该方法提供的监督信号能够更准确的表征真实深度。

实验结果表明,无论是结合哪种SOTA模型,所提出的方法都能带来显著的性能提升。定性可视化结果也清晰地展示了其优势:不论是自动驾驶场景还是仿真场景,在面对细小物体时都可以生成正确的深度细节。

而在开放道路场景,在处理远距离物体和具有复杂表面的物体(比如树木,草地)等,基于高斯采样(Sampling-Gaussian)的方法都无一例外体现出了更精确的深度估计能力。

论文贡献

该研究不仅提出高斯采样(Sampling-Gaussian)方法,更从理论、技术、行业三个层面为计算机视觉中的立体匹配提供以下突破:

理论层面:填补视差回归的认知空白

首次将立体匹配中的 “视差回归” 问题转化为 “向量点积” 问题,突破传统 scalar-based(标量驱动)的损失设计思路,提出的 “L1 损失 + 余弦相似度” 组合函数,为解决 “多峰分布导致的深度模糊” 提供了全新理论框架,也为后续视差回归算法设计提供了新视角。

技术层面:破解“精度-速度”的权衡困局

过往改进方案需在 “提精度” 和 “保速度” 间二选一,而高斯采样(Sampling-Gaussian) 方法通过高斯分布监督与插值优化,在不增加推理耗时、不依赖额外算力的前提下,实现精度全量提升,解决了行业长期面临的 “实时性与准确性不可兼得” 难题,为机器人的高精度深度感知提供了可行路径。

应用层面:降低行业落地门槛

高斯采样(Sampling-Gaussian)方法无需重构现有模型,仅需修改少量代码即可适配 PSMNet、IGEV-Stereo 等主流立体匹配框架—— 这意味着企业无需投入大量研发成本重构算法,就能快速升级现有系统的深度感知能力,加速人形机器人在工业场景的技术落地。

优必选全新一代工业人形机器人Walker S2

具备国内首个端到端“类人眼”双目立体视觉感知

落地可期

仅需少量代码,即可将这一“高斯采样(Sampling-Gaussian)方法”嵌入PSMNet、IGEV-Stereo等基于深度学习的主流深度估计。从无人驾驶到工业质检,高精度深度感知正因此变得触手可及。或许很快,无论是无人物流车的精准识别,还是人形机器人的灵巧抓取,都将因此获得更为强大的感知能力。

2026“全国移动机器人行业活动”合作商招募中

报名热线:400-0756-518、13512726426 同微信

活动时间:2025-08-01至08-31

Copyright © 2018-2025, 服务热线 400-0756-518

www.zhineng518.com,All rights reserved

版权所有 © 518智能装备在线 未经许可 严禁复制 【冀ICP备19027659号-2】 【公安备13050002001911】

运营商:河北大为信息科技有限公司